Hva er en AI-stack? Fem lag forklart

Nøkkelinnsikt

- Modellen er bare ett av fem lag. Infrastruktur, data og orkestrering er like avgjørende for resultatet.

- Selv verdens smarteste modell vet ikke hva som skjedde etter at treningen stoppet. RAG kobler AI til informasjon den ikke hadde fra starten.

- Orkestreringslaget er det raskest voksende: nye protokoller som MCP gjør at AI kan planlegge, handle og korrigere seg selv.

- Hvert lag begrenser det neste. GPUen din bestemmer hvilke modeller du kan kjøre. Dataene dine bestemmer hva modellen vet.

Dette er et AI-generert sammendrag. Kildevideoen kan inneholde demonstrasjoner, visuelt innhold og ytterligere kontekst.

Kort fortalt

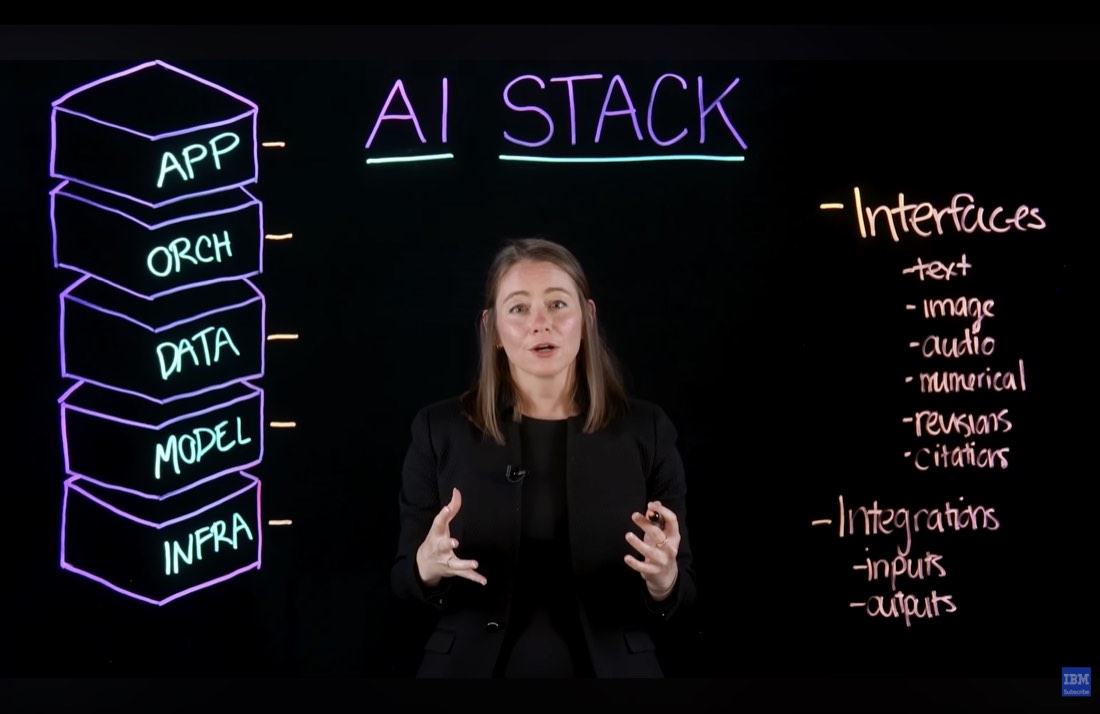

Alle snakker om hvilken AI-modell som er best. Men en modell alene løser ingenting. IBM har laget en enkel gjennomgang av de fem lagene du faktisk trenger for å bygge et AI-system som faktisk fungerer: infrastruktur, modeller, data, orkestrering og applikasjon. Hvert lag påvirker de andre, og valgene du tar tidlig setter grenser for hva du kan få til.

Les også:

Lag 1: Infrastruktur

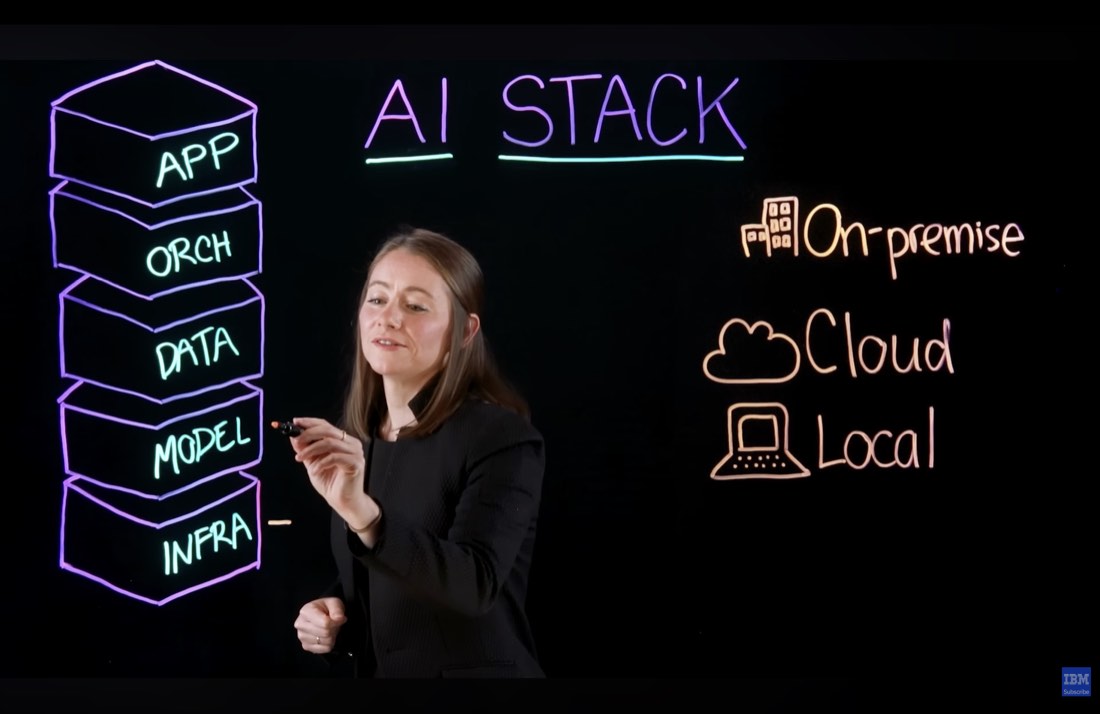

Det første laget handler om maskinvaren AI-modellen kjører på. Ikke alle store språkmodeller kan kjøre på vanlige bedriftsservere, og ingen av de store klarer seg på en standard laptop uten spesialisert maskinvare.

AI-modeller bruker GPUer (Graphics Processing Unit, en spesialbrikke for tunge beregninger), og de kan settes opp på tre måter: on-premise (i eget datasenter), i skyen (du leier kapasitet og justerer etter behov), eller lokalt på en bærbar PC (kun mulig med de minste modellene). Hva du har tilgang til, setter rammene for alt som kommer etter.

Lag 2: Modeller

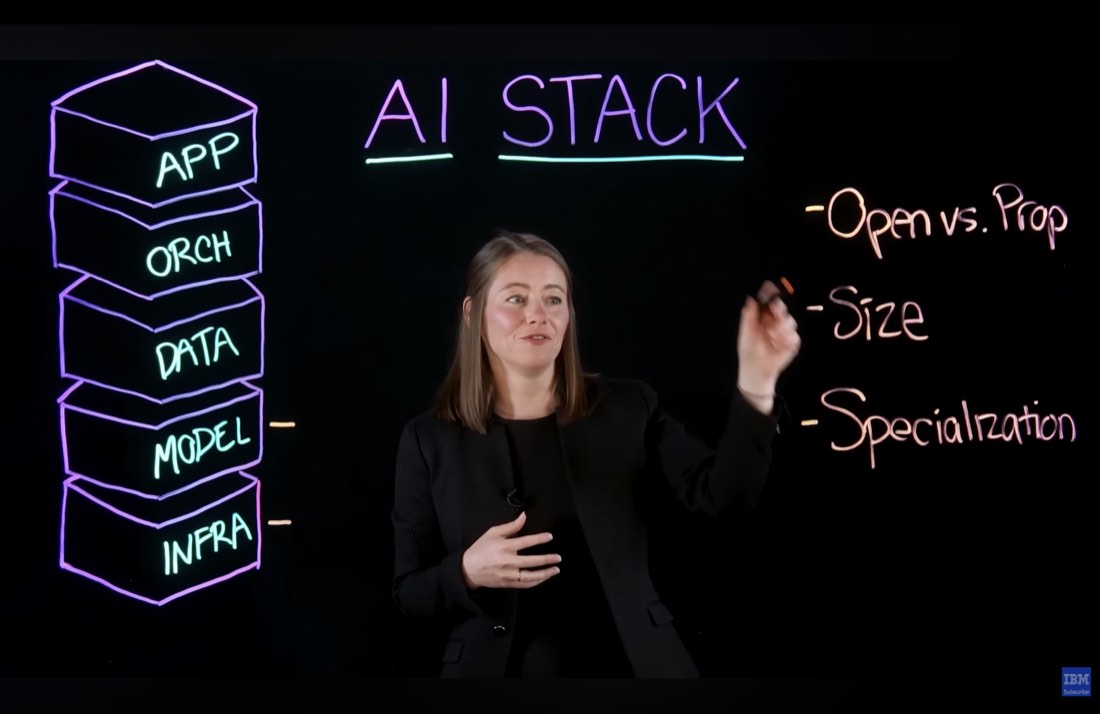

Neste lag er selve modellen, og her er valgmulighetene mange. Det finnes over 2 millioner modeller i kataloger som Hugging Face, og tre ting skiller dem.

Åpen eller lukket er det første spørsmålet: åpne modeller kan brukes fritt og tilpasses, mens lukkede modeller (som ChatGPT) eies av ett selskap og er kun tilgjengelige gjennom dem. Deretter kommer størrelse: store språkmodeller er kraftigere, men krever mer maskinvare. Og til sist spesialisering, noen modeller er trent for å være gode på koding, andre på resonnering eller bestemte språk. Det finnes ikke én universalt beste modell, bare den riktige for jobben.

Lag 3: Data

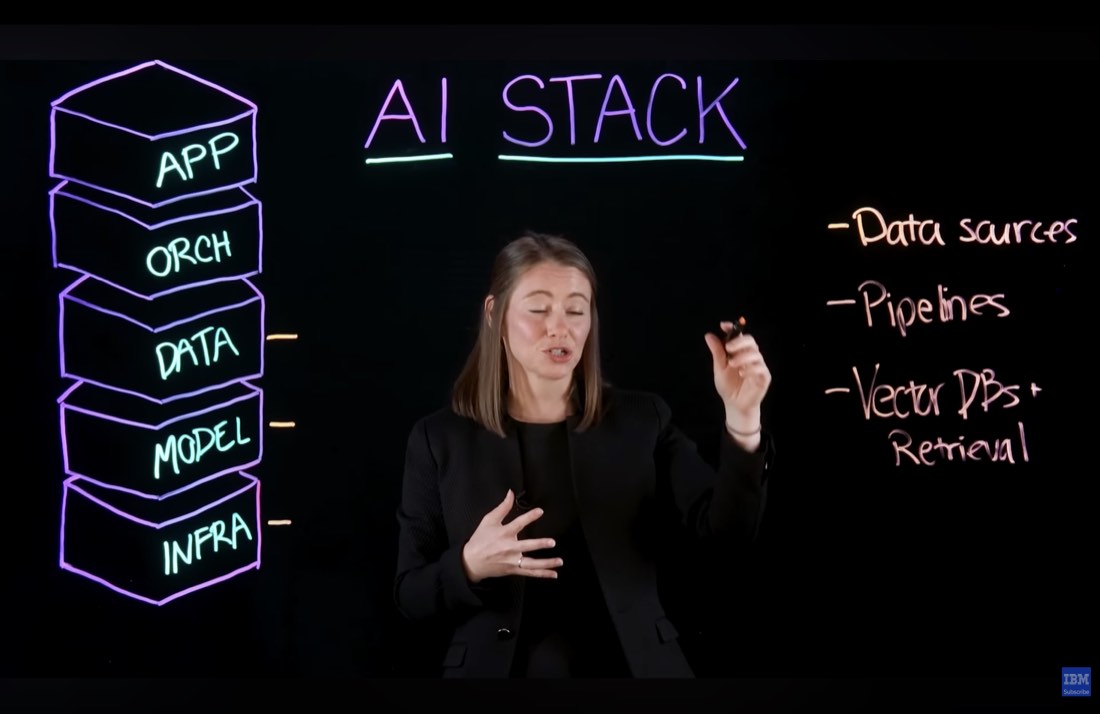

Alle modeller har en kunnskapsgrense (knowledge cutoff), altså en dato da treningen stoppet. Alt som har skjedd siden, vet modellen ingenting om. Det er det datalaget løser.

Datalaget består av datakilder (dokumenter, databaser, nettsider), pipelines (prosesser som forbereder og renser data), og vektordatabaser. En vektordatabase lagrer tekst som tallsekvenser slik at AI-en kan søke gjennom dem raskt. Denne teknikken kalles RAG, retrieval-augmented generation, og betyr at modellen slår opp relevant informasjon før den svarer. Tenk på det som å gi modellen en oppdatert oppslagsbok rett før eksamen, i stedet for å trene den på nytt fra bunnen.

Lag 4: Orkestrering

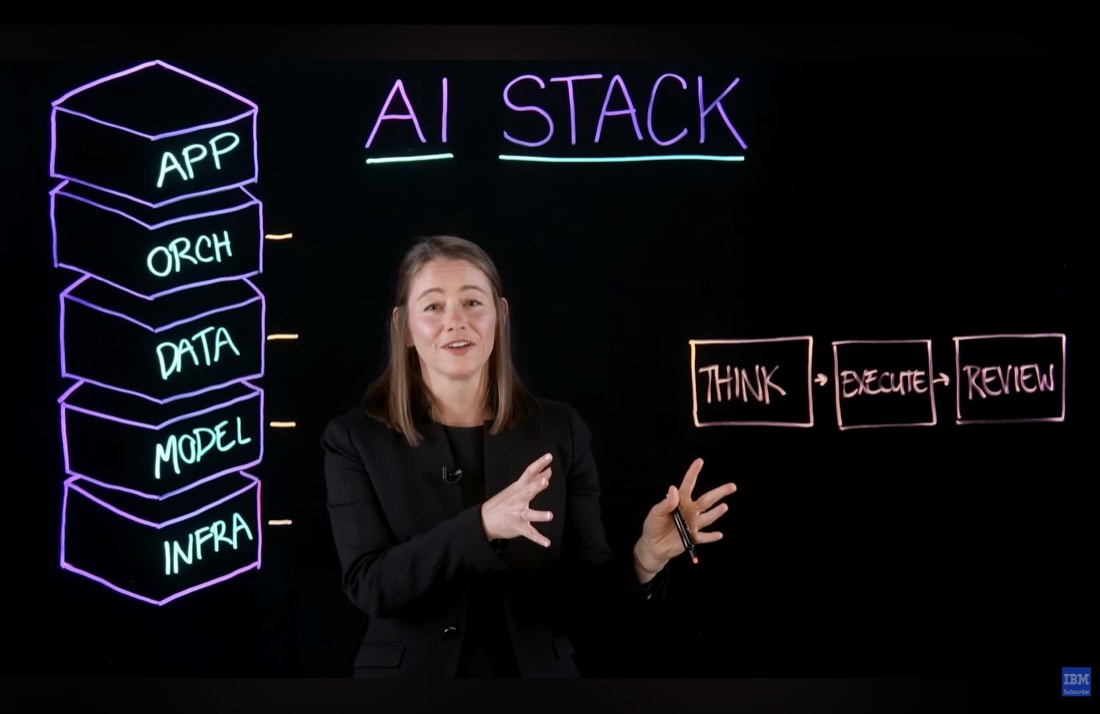

Komplekse oppgaver lar seg ikke løse med ett enkelt spørsmål inn og ett svar ut. Orkestreringslaget bryter ned det brukeren spør om i mindre deloppgaver som løses i rekkefølge.

Prosessen begynner med tenking: modellen planlegger hvordan den vil angripe problemet. Så kommer utføring, der den kaller på verktøy eller funksjoner for å gjøre noe konkret. Til sist gjennomgår den svaret sitt og kan starte en feedback-sløyfe for å forbedre det. Dette laget utvikler seg raskere enn noe annet, med nye protokoller som MCP (Model Context Protocol).

Forklart enkelt: Tenk på MCP som en universal adapter. I stedet for at AI-modellen må bygges om for hvert verktøy den skal snakke med, gir MCP den ett felles språk for å koble seg til kalendere, databaser, nettsider og andre tjenester. Hvert verktøy som kobles til gir modellen tilgang til noe nytt: ferske data, muligheten til å kjøre kode, eller regler for en bestemt oppgave.

Lag 5: Applikasjon

Det øverste laget er det brukeren faktisk ser og bruker. De fleste tenker på AI som tekst inn og tekst ut, men det er bare ett av mange mulige grensesnitt. Bilder, lyd, tallsett og egendefinerte dataformater er alle alternativer.

To funksjoner er kritiske for brukervennlighet: muligheten til å redigere og stille oppfølgingsspørsmål, og kildehenvisninger som lar svarene spores tilbake til kilden. I tillegg handler dette laget om integrasjoner: kan andre verktøy sende data inn i AI-systemet, og kan svarene automatisk havne der brukeren trenger dem i hverdagen?

Alt henger sammen

Valgene du tar gjennom hele stacken påvirker kvalitet, hastighet, kostnad og sikkerhet. GPUen begrenser modellene. Modellens treningsdata begrenser hva den vet. Datalaget begrenser hva den kan slå opp. Orkestreringslaget begrenser hva den kan gjøre. Og applikasjonslaget bestemmer om det faktisk er nyttig for noen.

Å forstå alle fem lagene gjør deg i stand til å ta bevisste valg, enten du bygger et system selv eller velger en tjeneste som håndterer flere lag for deg.

Ordliste

| Begrep | Forklaring |

|---|---|

| AI-stack (AI stack) | Alle teknologilagene som til sammen utgjør et fungerende AI-system |

| GPU (Graphics Processing Unit) | Spesialbrikke for tunge beregninger, brukes til å kjøre AI-modeller |

| Kunnskapsgrense (knowledge cutoff) | Datoen da modellens trening stoppet. Modellen kjenner ikke til hendelser etter denne datoen |

| RAG (Retrieval-Augmented Generation) | Teknikk der AI-en slår opp relevante dokumenter fra en database før den svarer |

| Vektordatabase (vector database) | Database som lagrer tekst som tallsekvenser slik at AI-en kan søke raskt |

| Orkestrering (orchestration) | Laget som bryter oppgaver i delsteg og koordinerer hvordan AI-en løser dem |

| MCP (Model Context Protocol) | Protokoll som lar AI-modeller koble seg til eksterne verktøy og datakilder |

Kilder og ressurser

- Source video: What Is an AI Stack? LLMs, RAG, & AI Hardware — IBM Technology

- Hugging Face Model Hub — Modellkatalog omtalt i videoen

Vil du vite mer? Se hele videoen på YouTube →